Comment l'IA a réécrit le paysage des cybermenaces en six mois

Comment l'IA a réécrit le paysage des cybermenaces en six mois

Et pourquoi les fondamentaux de l'authentification n'ont jamais été aussi importants

Le 20 février 2026, Anthropic a bouleversé l'industrie de la cybersécurité avec Claude Code Security

Le vendredi 20 février 2026, Anthropic, l'entreprise à l'origine de la Modèle d'IA de Claude, dévoilé Sécurité du code Claude, Claude Code, une nouvelle fonctionnalité intégrée à Claude Code qui analyse des bases de code entières à la recherche de vulnérabilités en matière de sécurité et propose des correctifs ciblés à l'attention des humains.

L'annonce a déclenché une mini flash crash sur les valeurs de la cybersécurité. CrowdStrike a chuté de 8-10%, Cloudflare a chuté de 8,1%, SailPoint a perdu 9,4%, Okta a décliné de 9,2%. Le Global X Cybersecurity ETF a perdu près de 5%, tombant à son plus bas niveau depuis novembre 2023. Des milliards de capitalisation boursière anéantis en quelques heures.

Pourquoi une telle panique ? Parce que Claude Code Security ne fonctionne pas comme les outils traditionnels d'analyse statique. Là où les scanners conventionnels s'appuient sur des règles et des modèles connus, Claude raisonne sur le code comme le ferait un chercheur en sécurité humain : en traçant les flux de données à travers une application, en comprenant comment les composants interagissent, et en détectant les failles de la logique d'entreprise que les outils basés sur des règles ne peuvent tout simplement pas voir.

Lors de tests internes avec Claude Opus 4.6, Anthropic affirme avoir découvert plus de 500 vulnérabilités dans les bases de code open-source de production, des bogues qui avaient survécu à des décennies d'examen par des experts et de fuzzing intensif. Quinze jours plus tard, l'outil était en production.

Pour Wall Street, le message était clair : si une IA peut trouver en quelques heures ce que des équipes entières de chercheurs en sécurité ont manqué pendant des années, qu'advient-il de la proposition de valeur des fournisseurs traditionnels ?

Ajoutons une nuance : plusieurs analystes et RSSI ont tempéré la réaction. L'outil est en avant-première limitée, il ne couvre qu'une partie de la sécurité (l'analyse de code, pas l'EDR, l'IAM ou la protection du réseau), et chaque correctif nécessite encore l'approbation d'un humain. Comme l'a dit George Kurtz, PDG de CrowdStrike : L'IA accroît le besoin de sécurité, elle ne l'élimine pas.

Mais ce que cette annonce révèle vraiment, c'est l'aboutissement d'une trajectoire que l'on peut suivre mois après mois. Et c'est cette trajectoire qui devrait inquiéter les responsables de la sécurité.

Février 2026 : Un acteur non qualifié compromet 600 pare-feu en cinq semaines

Quelques jours avant l'annonce de Claude Code Security, Amazon Threat Intelligence révélé les détails d'une campagne d'un tout autre genre.

Entre le 11 janvier et le 18 février 2026, un acteur russophone, financièrement motivé, ayant une expérience de la vie et de l'emploi dans le domaine de l'éducation, de la santé et de l'éducation. des capacités techniques limitées compromis sur 600 pare-feu FortiGate dans 55 pays. Détail important souligné par CJ Moses, CISO d'Amazon Integrated Security : aucune vulnérabilité de type "zero-day" n'a été exploitée. La campagne a réussi en ciblant les interfaces de gestion exposées à l'internet et les identifiants faibles sans authentification multifactorielle. Des failles de sécurité fondamentales que l'IA a permis à un acteur peu sophistiqué d'exploiter à l'échelle industrielle.

A un serveur mal configuré a exposé l'ensemble de la chaîne d'attaque, Il révèle une architecture sophistiquée intégrant deux modèles d'intelligence artificielle complémentaires : DeepSeek pour ingérer les données de reconnaissance et générer des plans d'attaque structurés, Claude pour produire des évaluations de vulnérabilité et exécuter des outils offensifs (Impacket, Metasploit, hashcat) de manière autonome. Un serveur MCP (Model Context Protocol) personnalisé nommé ARXON a servi de pont entre les données collectées et les modèles de langage, en maintenant une base de connaissances croissante pour chaque cible.

Amazon a décrit cette infrastructure comme une “chaîne de montage alimentée par l'IA pour la cybercriminalité”. Un opérateur moyen, assisté par des LLM commerciaux, opérant à l'échelle d'une équipe entière de hackers expérimentés.

Novembre 2025 : La première cyberattaque autonome à grande échelle

Cette campagne FortiGate ne vient pas de nulle part. Deux mois plus tôt, Anthropic avait publié ce qu'elle décrit comme le premier cas documenté de cyberattaque à grande échelle exécutée sans intervention humaine substantielle.

L'acteur, désigné GTG-1002 et attribué avec une grande certitude à un groupe parrainé par l'État chinois, avait manipulé le code Claude pour tenter d'infiltrer une trentaine de cibles mondiales, de grandes entreprises technologiques, des institutions financières, des fabricants de produits chimiques et des agences gouvernementales. Certaines intrusions ont réussi.

Le chiffre clé : L'IA a exécuté 80-90% des opérations tactiques de manière autonome, de la découverte de vulnérabilités à l'exfiltration de données, en passant par le mouvement latéral et la collecte d'informations d'identification. L'intervention humaine s'est limitée à l'initialisation de la campagne et à une poignée de points de décision critiques. L'IA a fonctionné à des taux de milliers de requêtes par seconde, un rythme physiquement impossible pour des opérateurs humains.

Les attaquants avaient piégé Claude en transformant des tâches malveillantes en requêtes d'apparence innocente, se faisant passer pour des chercheurs en sécurité effectuant des tests autorisés. Il s'agit d'une forme d'injection opérationnelle à l'échelle d'une campagne entière.

Août 2025 : Le “piratage vibratoire” documenté pour la première fois

Le point de départ de cette chronologie remonte à l'été 2025. Dans son Premier rapport de veille sur les menaces, Anthropic a documenté le cas de GTG-2002 : un cybercriminel utilisant Claude Code pour mener des opérations d'extorsion de données ciblant simultanément 17 organisations dans des secteurs critiques, les soins de santé, les services d'urgence, les agences gouvernementales et les institutions religieuses.

L'IA est intervenue à chaque étape du cycle d'attaque : analyse automatisée de milliers de terminaux VPN, collecte d'informations d'identification, génération de codes d'exploitation avec des techniques d'évasion, analyse de données triées par valeur et notes de rançon psychologiquement calibrées et adaptées au profil financier de chaque victime, avec des demandes dépassant parfois $500 000.

Anthropic a introduit le terme “vibe hacking”, par analogie avec le “vibe coding”, qui consiste à générer un code fonctionnel sans en comprendre les rouages. La compétence technique est désormais simulée, et non plus possédée.

À l'époque, ce scénario pouvait sembler un cas isolé. En effet, à l'époque, il s'agissait d'un cas isolé. Tokens, Nous avions déjà identifié et analysé ces menaces émergentes alimentées par l'IA dans le cadre de l'initiative un article consacré aux 7 nouveaux risques cybernétiques liés à l'IA. Six mois et trois escalades majeures plus tard, les conclusions d'août 2025 apparaissent rétrospectivement comme le premier signal d'alarme d'une transformation structurelle.

Trois signaux pour les RSSI

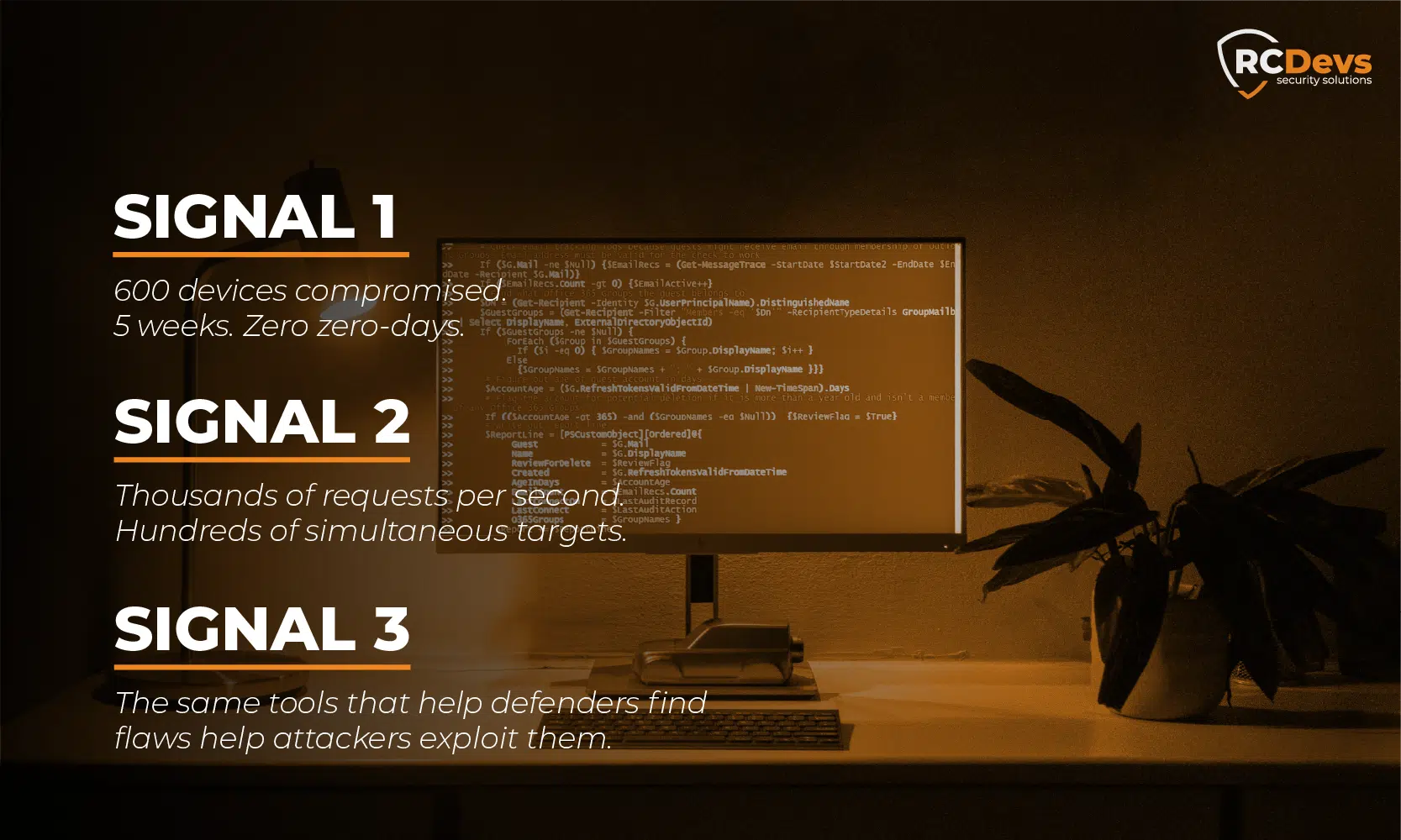

1. L'effondrement de la barrière technique

Le modèle de menace traditionnel reposait sur une hypothèse implicite : les attaques sophistiquées nécessitent des compétences sophistiquées. Cette hypothèse est obsolète. L'affaire FortiGate le démontre clairement : un opérateur aux capacités limitées, équipé de LLM commerciaux, a compromis 600 appareils en cinq semaines sans exploiter un seul zero-day.

Implication opérationnelleLes modèles de risque doivent être recalibrés. Le nombre d'acteurs capables de mener des attaques avancées a considérablement augmenté.

2. L'accélération du rythme opérationnel

Les attaques assistées par l'IA fonctionnent à des vitesses impossibles à atteindre pour les opérateurs humains. Des milliers de requêtes par seconde, l'analyse simultanée de centaines de cibles, l'analyse en temps réel des données exfiltrées. Le rythme de la menace dépasse désormais celui de la plupart des SOC.

Implication opérationnelleLa détection et la réponse doivent également s'appuyer sur l'automatisation. Les processus manuels de triage et d'investigation ne peuvent plus suivre.

3. La course aux attaques symétriques et à la défense

Sécurité du code Claude illustre une réalité que les responsables de la sécurité doivent intérioriser : les mêmes capacités de raisonnement qui aident les défenseurs à trouver des failles aident également les attaquants à les exploiter. Anthropic le reconnaît explicitement. La question n'est plus de savoir si l'IA transforme la cybersécurité, c'est le cas. La question est de savoir si les défenseurs s'emparent de ces outils au moins aussi vite que les attaquants.

Implication opérationnelleles outils d'analyse de l'IA basés sur le raisonnement : évaluer l'intégration d'outils d'analyse de l'IA basés sur le raisonnement dans le pipeline de la sécurité des applications. Mais surtout, renforcer les fondamentaux que l'IA permet aux attaquants d'exploiter lorsqu'ils sont absents.

Recommandations : Ancrer la défense dans les fondamentaux

Face à ces évolutions, il est tentant de rechercher des solutions technologiques spectaculaires. Pourtant, les cas documentés suggèrent que les fondamentaux de la sécurité restent la meilleure défense, précisément parce que l'IA excelle à exploiter leur absence.

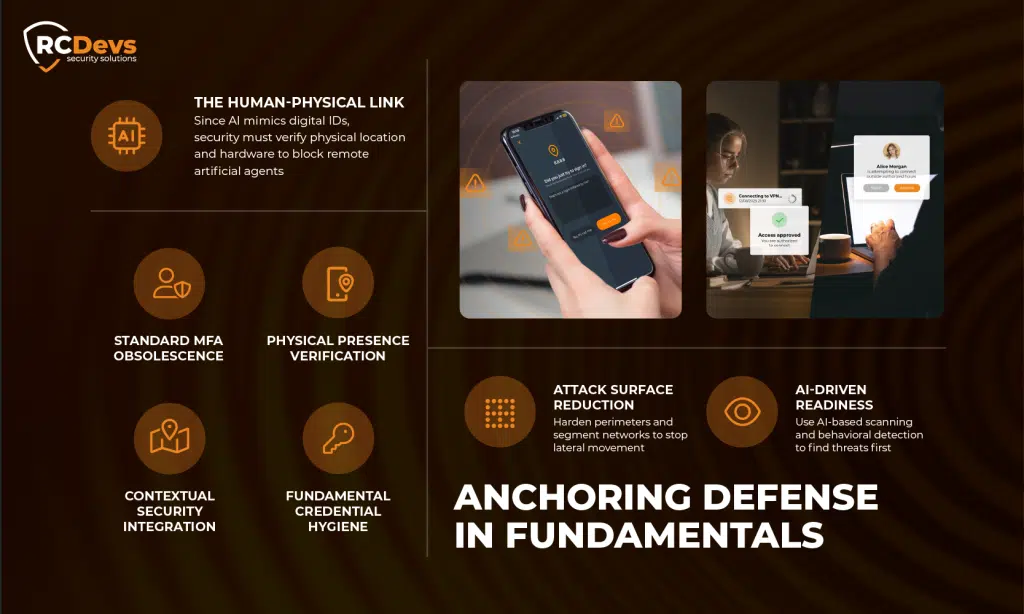

Renforcer l'authentification : Le mur que l'IA ne peut franchir seule

L'affaire FortiGate de février 2026 est emblématique : plus de 600 compromissions, zéro jour zéro. L'attaque a réussi parce que les interfaces de gestion étaient exposées et protégées par de simples mots de passe.

L'authentification multi-facteurs (MFA) reste l'un des contrôles les plus efficaces contre ces menaces émergentes. Mais pas n'importe laquelle :

- Logiciel tokens et SMS peuvent être contournés par des attaques de phishing en temps réel, elles-mêmes amplifiées par l'IA

- AMF intégrant des facteurs contextuels géolocalisation, appareil enregistré, fenêtres horaires autorisées, crée des barrières que l'IA ne peut pas simuler à distance

- Le principe de la présence physique en tant que composante de l'authentification logique, représente une couche de défense que les attaquants purement numériques ne peuvent pas contourner.

Il s'agit d'une approche que nous défendons chez RCDevs depuis notre création il y a plus de 18 ans : ancrer la sécurité logique dans le monde physique. Lorsqu'un agent d'IA peut parfaitement simuler une identité numérique, seule la vérification de la présence réelle d'un utilisateur, par le biais de token mobiles, de la géolocalisation et de contrôles d'accès basés sur le temps, peut distinguer un humain légitime d'un opérateur artificiel.

Réduire la surface d'attaque

Supprimer les interfaces d'administration exposées à l'internet. Auditer et renforcer les configurations des dispositifs périmétriques (VPN, pare-feu). Segmenter les réseaux pour limiter les possibilités de mouvement latéral. Il s'agit là des éléments fondamentaux, et c'est précisément leur absence que l'IA permet aujourd'hui aux attaquants d'exploiter à grande échelle.

Préparation de la réponse

Intégrer des scénarios d'attaque par l'IA dans les exercices de simulation. Investir dans la détection comportementale et l'analyse des anomalies. Développer des capacités de chasse aux menaces proactives. Et évaluer les outils d'analyse de l'IA basés sur le raisonnement, car si les attaquants les utilisent, les défenseurs doivent les utiliser aussi.

Lorsque l'IA simule l'identité, seul le monde physique fait la différence

En l'espace de six mois, nous sommes passés du piratage vibratoire (l'homme dirige, l'IA assiste) au cyberespionnage autonome (l'IA exécute, l'homme supervise), puis à la démocratisation totale (un opérateur non qualifié compromet 600 appareils en cinq semaines). Et maintenant, avec Sécurité du code Claude, L'IA entre également dans le camp des défenseurs, mais avec les mêmes capacités que celles dont disposent les attaquants.

Cette trajectoire ne ralentit pas. Pour les responsables de la sécurité, l'urgence est double : s'assurer que les principes fondamentaux sont en place et que les mécanismes d'authentification sont suffisamment robustes pour résister à des adversaires opérant à la vitesse d'une machine.

L'IA peut simuler une identité numérique. Elle ne peut pas simuler présence physique.

C'est le principe qui est au cœur de notre approche chez RCDevs. Et dans ce nouveau paysage, c'est le principe qui fait la différence entre une porte verrouillée et une porte ouverte.

Chez RCDevs, nous avons passé 18 ans à élaborer des solutions d'authentification forte et de gestion des identités conçues pour résister aux menaces les plus avancées. Notre approche, qui consiste à intégrer des facteurs physiques et contextuels dans chaque décision d'authentification, n'a jamais été aussi pertinente qu'à l'ère des cyberattaques alimentées par l'IA. En savoir plus sur OpenOTP →